(原标题:英伟达真正的对手是谁)图片来源于网络,如有侵权,请联系删除

刘劲 段磊 李嘉欣/文图片来源于网络,如有侵权,请联系删除

算力是人工智能最重要的基础设施和发展引擎。AI算力的代表企业英伟达(NVIDIA)凭借性能先进的产品和难以复制的生态,在AI训练及推理芯片领域建立起了近乎垄断的领导地位,成为地球上价值最高的上市公司。截至2025年11月,英伟达的市值约为4.5万亿美元,2025年第三季度营收的同比增长约为62%。图片来源于网络,如有侵权,请联系删除

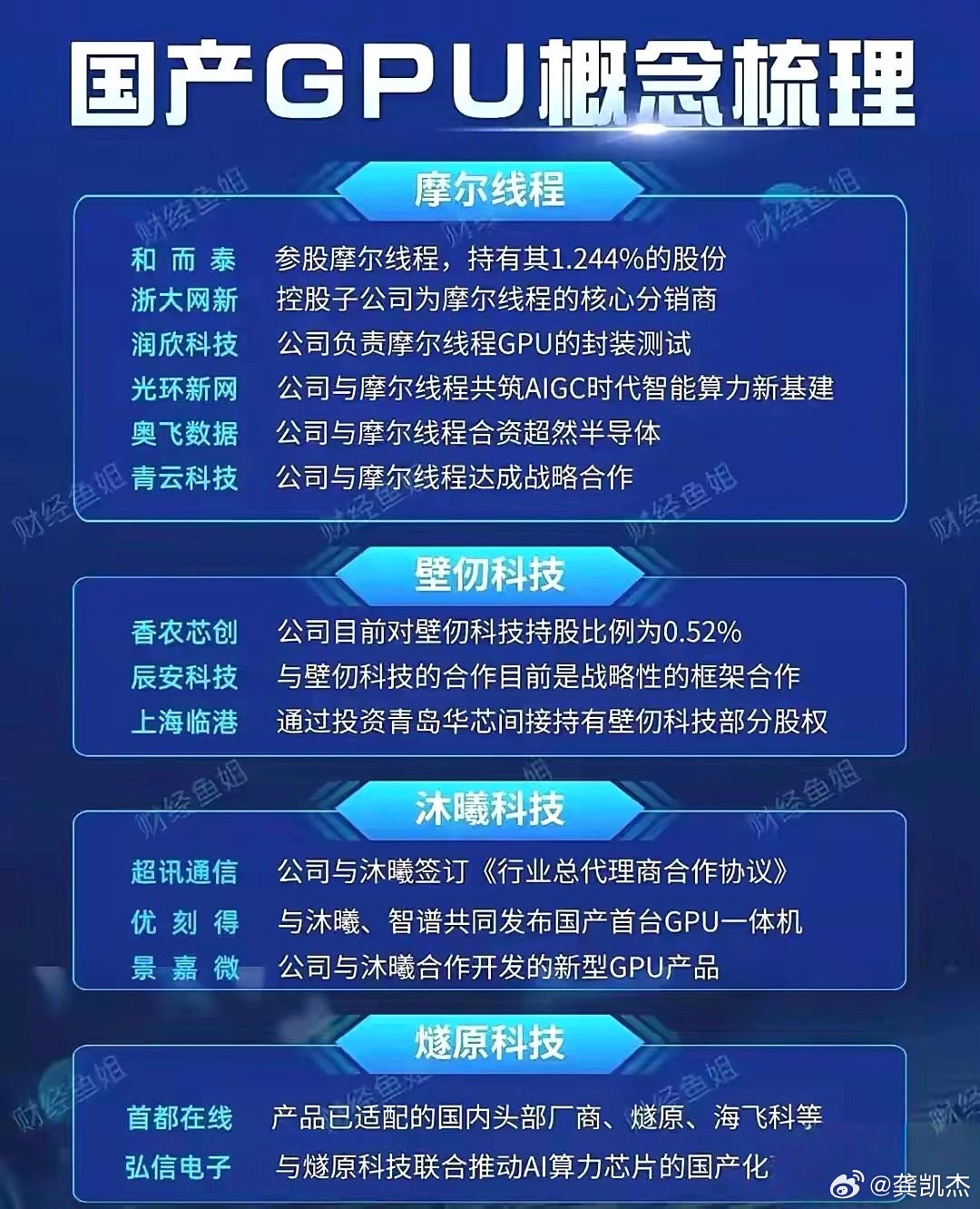

英伟达并不缺少挑战者,在美国有传统芯片巨头安谋(AMD)和英特尔,也有谷歌的TPU、亚马逊的Trainium(训练芯片)和Inferentia(推理芯片)等科技巨头的自研算力,还有Cerebras、Groq等专注机器学习优化架构的新锐挑战者;中国市场也有华为、寒武纪、燧原等快速成长的AI算力芯片厂商。但到目前为止,他们都很难称得上是英伟达的对手,难以撼动其领导地位。不过,未来这一点未必不会改变。

竞争壁垒

AI算力芯片有两个主要应用场景:训练和推理。训练是模型从大量数据中“学习”知识(调整神经网络的参数),推理是把训练好的模型用在实际场景中。

在大模型发展的初期和中期,训练算力是核心瓶颈,决定了模型的“高度”,是算力芯片的战略制高点。因此,我们在此着重讨论训练。

英伟达在训练算力上有统治性的地位。这种优势来自两个方面:先进的技术和生态的垄断。

主流大模型的参数规模已达千亿、万亿级别,训练时要对海量数据进行大规模计算,单机算力早已远远不够,必须依托大规模芯片集群完成训练;要令这复杂而成本高昂的训练易于展开、效率高、稳定可靠,还需要一整套的软件系统和工具来作为连接训练工程师、算力芯片和模型的桥梁。

因此,我们大致可以将训练对算力芯片的要求拆解成单芯片性能(单卡性能)、互联能力和软件生态三部分。

单芯片性能原本主要指计算能力(FLOPS,每秒浮点运算次数)。训练大模型需要加载海量参数、进行大量的数据快速吞吐,所以还需要为训练芯片配置大容量高带宽的存储(HBM)。

因为工艺的差异,厂商通常会把显存和算力芯片做成独立的芯片,然后封装在一起或在电路板上进行集成,所以叫单卡性能更准确。用户们会关注单卡的计算能力、显存容量与带宽、计算精度、功率与能效等。

英伟达在单卡性能上处于行业顶尖水平,但竞争对手也在追赶,尤其是AMD的最新产品在主要性能指标上已经达到接近英伟达同期产品的水平。不过,对于AMD等企业的坏消息是:单卡的性能迫近英伟达,并不足以撼动其在AI训练领域的领先优势。

互联能力对大模型训练非常重要。大模型训练本质上是“分布式并行计算”问题,互联就是分布式的“血管与神经”。前沿大模型的训练已经要求数万张算力卡的互联并行工作,这对大模型厂商是极具挑战的工程,对算力芯片厂商的要求也极高。

英伟达凭借专有互联技术NVLink、高性能的通信交换硬件NVSwitch等做到了万卡级的高效、稳定互联。其他AI芯片企业实际落地的集群规模大部分仍停留在千卡规模,且很多是采用切割成多个小规模集群的方式进行部署,与英伟达的纯万卡并行计算集群差距很大。

互联的规模、质量、稳定性对算力利用效率、训练时间、训练成本甚至训练成功与否都有显著影响,选择次优方案带来的潜在损失,可能远大于成本的节省,这令英伟达方案有极大的吸引力。这导致即便其他厂商的互联技术能有提升,其缺乏大规模的落地商用实践去发现问题和优化方案,无疑加大了他们在互联能力上挑战英伟达的难度。

除了技术上的优势之外,英伟达更重要的优势在于对算力生态的统治地位。这个生态优势来自软件,而不是硬件。和硬件不同,软件有很强的网络效应,因此能对用户产生巨大的黏性。

CUDA是英伟达有20年积累的GPU并行计算的编程平台,这个平台上提供了成熟的开发和调试工具、丰富且经过充分验证的软件库和函数库、海量的文档和教程支持,让开发者的工作变得更简单、高效。400多万开发者通过贡献开源库和工具、反馈bug(漏洞)和提供最佳实践,又令CUDA的软件生态变得更好。

英伟达的其他软件和工具又能和CUDA生态配合,对用户形成更强粘性,如英伟达提供的大模型开发框架NeMoFramework、帮助企业快速部署AI的NVIDIAAIEnterprise等。

除了开发者,学术界研究员发表的最新AI论文(如Transformer架构的变体),其开源代码通常只在英伟达GPU上验证过。如果用其他芯片,研究者可能需要自己去写底层适配代码,才能跑通新模型。这意味着使用英伟达,研究者能最早用上最先进的技术。

更进一步,全球的高校计算机专业、AI实验室,教学和实验用的设备几乎全是英伟达的GPU。一个刚毕业的AI工程师,大概率已经熟练掌握了CUDA编程。如果一家公...